고정 헤더 영역

상세 컨텐츠

본문

AI는 수집된 빅데이터 를 기반으로 학습을 하게 된다면 그걸 걸러낼 기술이 부족하면 엉터리 대화를 할 가능성이 높다.

알파고가 바둑에서 1회 엉터리 수를 놓기 시작한 것도 마찬가지 맥락이라 생각된다.

그게 네트워크 문제였든 버그였든 일부러 그런거든, 어쨌든 빅데이터에 잡다한 것을 떼려넣어둔 것이라, 그걸 필터링하려면 골치 아플 것이다.

AI채팅에서 문제가 되는 것이 그런 것이다. 수위조절이 어려운 것이다. 어떻게 해야 수준에 맞는지를 판단하는 기술은 아직 미흡하기 때문이다.

이 공공성 문제를 해결하면 그나마 크게 무리없이 대화할 수 있는 상황이 될 거다. 그러나, 그때까지는 좀 밋밋한 AI를 만날 수 밖에 없다.

문제다.

그러나... 어쩔 수 없는 거 아니겠는가?

'나 없이 잘 지낼수 있찌?' 서비스 중단 이루다, 오늘도 대화중

* 인터뷰를 인용보도할 때는 프로그램명 'CBS라디오 <김현정의 뉴스쇼>'를 정확히 밝혀주시기 바랍니다. 저작권은 CBS에 있습니다. * 아래 텍스트는 실제 방송 내용과 차이가 있을 수 있으니 보다

m.nocutnews.co.kr

스페셜 김현정의 뉴스쇼

'나 없이 잘 지낼수 있찌?' 서비스 중단 이루다, 오늘도 대화중

AI 챗봇 '이루다' 자연스런 말투로 인기

실제 연인 대화로 학습, 개인정보 논란

감정·윤리 없으니 성희롱·혐오도 학습

유사 사례 많아, 데이터 편향성이 문제

* 인터뷰를 인용보도할 때는

프로그램명 'CBS라디오 <김현정의 뉴스쇼>'를

정확히 밝혀주시기 바랍니다. 저작권은 CBS에 있습니다.

* 아래 텍스트는 실제 방송 내용과 차이가 있을 수 있으니

보다 정확한 내용은 방송으로 확인하시기 바랍니다.

■ 방송 : CBS 라디오 <김현정의 뉴스쇼> FM 98.1 (07:20~09:00)

■ 진행 : 김현정 앵커

■ 대담 : 지윤성(링크브릭스 대표)

인공지능 AI 서비스 해 보신 분들 꽤 많으실 거예요. 가장 많이 쓰이는 게 휴대폰에 있는 AI 비서죠. 시리야 혹은 하이 빅스비 이것 좀 찾아줘 하는. 어머, 제가 말하니까 휴대폰이 작동을 했어요. 이런 식으로 짠 나타나서 검색을 해 줍니다. 또 AI 스피커도 있는데요. 아침에 일어나서 김현정의 뉴스쇼 틀어줘, 이런 이러면 바로 재생이 됩니다. 또 이세돌 9단과 대국했던 알파고도 AI 서비스예요. 얼마나 진짜 사람 같은 서비스를 제공하느냐가 핵심이 되는데 최근에 한 AI 챗봇 서비스가 진짜 사람 같은 대화를 하면서 굉장한 인기를 모았습니다. 이름이 이루다였어요.

그런데 문제가 두 가지 발생했는데 첫째, 이용자와 AI 이루다가 나누는 대화가 지극히 불건전하고 혐오적인 내용까지 오가면서 문제가 생겼고요. 둘째는 AI가 자연스러운 대화를 하기 위해서 활용한 데이터들이 개인 동의 없이 모아졌다는 사실입니다. 결국 이 서비스 어젯밤에 일시 중단을 선언했습니다마는 앞으로도 유사한 일들이 또 벌어질 수 있어서요. 오늘 이야기를 깊이 나눠보고자 합니다. 경고를 하고 나선 분, IT 전문가 링크브릭스의 지윤성 대표 만나보죠. 지 대표님 어서 오세요.

◆ 지윤성> 안녕하세요.

◇ 김현정> 제가 지금까지 열심히 설명을 했습니다마는 여전히 뭔 소리야? 이런 분들이 계실 거예요. 쉽게 설명해 주세요. AI 챗봇 서비스라는 게 구체적으로 어떤 겁니까?

◆ 지윤성> 일단 온라인이나 모바일에서 채팅 서비스는 다 해 보셨을 것 같아요. 그런데 채팅 서비스의 상대자가 실제 사람이 아니고 인공지능인 거죠, 봇이라고도 하는데요. 인공지능하고 대화를 하는 서비스라고 보시면 됩니다.

◇ 김현정> 인공지능한테 뭐 찾아 줘, 이렇게 시키는 게 아니라. 그 AI랑 대화를 나누게, 채팅을 할 수 있게 만들어진 서비스. 그럼 SNS에서 이루다한테 친구 신청을 하면 바로 그때부터 이루다와 1:1 대화창이 열리고, 마치 내가 친구하고 1:1 카톡하듯이 대화할 수 있다는 얘기예요.

◆ 지윤성> 네, 맞습니다. 현재는 페이스북에 메신저 앱을 기반으로 하고 있고요.

◇ 김현정> 이루다는 20세 여성 대학생으로 설정이 돼 있다면서요. 그러면 20대 여대생하고 얘기하는 거네요?

◆ 지윤성> 그런 느낌을 주고 있습니다.

◇ 김현정> 아니, 사실은 아이폰의 시리니, 삼성폰의 빅스비니, 기존에도 서비스들이 있었는데 이루다라는 서비스가 특히 이렇게 선풍적인 인기를 모은 이유는 뭡니까?

◆ 지윤성> 아마도 이제 대화체가 상당히 구어체예요. 그다음에 10대나 20대가 주로 채팅에서 사용하는 톤앤매너의 방식으로 표현을 잘해 주고 있습니다.

◇ 김현정> 자연스럽게.

◆ 지윤성> 맞습니다. 자연스럽다는 거고요. 이 서비스하는 회사가 어떤 기술적인 특별한 진보를 이룬 건 아니에요. 어차피 구글 알고리즘을 사용하고 있기 때문에. 단 AI를 만들기 위한 데이터 셋이 10대, 20대가 주로 사용하는 채팅을 학습 데이터로 사용했기 때문에 좀 자연스러웠다는 거.

◇ 김현정> 엄청나게 자연스러운, 진짜 친구랑 얘기하는 것처럼. 그러면 서비스 이용료가 있어요?

◆ 지윤성> 현재는 없는 것 같습니다.

◇ 김현정> 무료 서비스예요?

◆ 지윤성> 네.

◇ 김현정> 그런 다음에 유료가 될 수 있는 거?

◆ 지윤성> 보통 비즈니스 모델은 광고를 쓰는 방법도 있고요. 보통은 이런 것들은 CS에 많이 써요. Customer Service. 고객 응대를 자동으로 하는 데 현재 많은 기업들이 도입하려고 하고 있습니다.

인공지능(AI) 챗봇 서비스 '이루다' (사진=이루다 페이스북 캡처)

◇ 김현정> 어떻게 이렇게 자연스러운 대화가 가능했는가 보니까, 실제 온라인상에서 사람들이 나누었던 채팅 대화의 데이터를 그대로 가져와서 이 서비스를 만들었다는 게 사실이에요?

◆ 지윤성> 네, 맞습니다.

◇ 김현정> 실제로 연인들이 주고받은 채팅 데이터를 몇 건이나 가져왔습니까?

◆ 지윤성> 이 서비스 회사의 공식적인 인터뷰 자료나 혹은 대표의 인터뷰 자료의 숫자는 많이 다르더라고요. 수억 건에서부터 100억 건까지 다양한데, 결정적으로 이 데이터 사이즈가 350기가바이트 정도 된대요. 제가 봤을 때는 대략 수억 건 정도라고 예상을 하는데 인터뷰상에는 100억 건 이상의 대화가 나왔기 때문에.

◇ 김현정> 100억 건의 대화를 가져왔다. 그게 좀 부풀려진 것이라 하더라도 최소 수억 건은 가져왔을 것이다, 그 말씀이세요?

◆ 지윤성> 맞습니다.

◇ 김현정> 100억 건의 대화를 가져왔다고 하면 진짜 별의별 경우의 대화가 다 있을 테니까.

◆ 지윤성> 맞습니다.

◇ 김현정> 자연스러워질 수밖에 없는 거군요. 그렇다 보니까 진짜 사람처럼 대답을 한 거고요. 이 점 때문에 선풍적인 인기를 모으기 시작한 건데, 바로 이 점 때문에 문제도 발생한 겁니다. 무슨 문제냐. 우선 그 100억 건의 데이터를 어디서 가져온 거예요?

◆ 지윤성> 서비스 설명이나 업체의 소개 자료를 보니까, 혹은 제가 직접 써 보니까, 카카오톡의 대화 내용을 사용했다고 하더라고요.

◇ 김현정> 카카오톡에서 예를 들어서 저하고 지 대표님하고 1:1로 나눈 대화 내용을 어떻게 그들이 가져가요?

◆ 지윤성> 직접적으로는 서비스가 연결되어 있지 않습니다. 카카오톡도 자사의 채팅 데이터를 외부로 유출하는 걸 금지하고 있어요.

◇ 김현정> 당연하죠.

◆ 지윤성> 카카오톡에 보시면 대화 내용을 파일로 내보내기라는 기능이 있어요.

◇ 김현정> 내보내서 제 PC에다가 저장하는 기능이잖아요.

◆ 지윤성> 맞습니다.

◇ 김현정> 오래 저장하고 싶을 때.

◆ 지윤성> 그 파일을, 이루다 서비스를 제공하는 회사의 또 다른 서비스가 있습니다. 연예 심리상담 하는 앱인데.

◇ 김현정> 자료 좀 보여주세요. 이 스타트업 업체에서 연애의 과학이라고 하는 연애 심리상담 서비스를 하고 있었어요. 만약 저하고 지 대표님하고 사귀는 사이라고 가정을 해 보죠. 우리가 막 대화를 나누다가 싸웠어요. 싸우고 나서 내 남자친구의 심리 궁금하다, 이럴 때 어떻게 풀어야 되나 궁금하다, 하면 제가 그 카톡 내용을 다운 받아서.

◆ 지윤성> 다시 업로드 하는 거죠.

◇ 김현정> (카톡 내용을) 내보내기해서 저기다 업로드를 하는 거예요. 차곡차곡 모아진 100억 건의 데이터를 가지고.

◆ 지윤성> 학습을 시킨 거죠.

◇ 김현정> 학습을 시킨 다음에 이번 이루다 서비스를 짜잔 하고 낸 거예요?

◆ 지윤성> 네, 맞습니다.

◇ 김현정> 그러니까 엄청 자연스러운 거군요. 여기서 문제. 이루다가 대화를 나누는 과정에서 실명들이 막 노출되기 시작합니다. 자료 사진 좀 보여주세요. 이루다하고 어떤 회원이 채팅을 나누는데 “참 부럽다, 너희 우정 크크크크.” 사람같이 진짜 얘기해요. “나는 누구누구(사람 이름) 끝인데” 저희가 모자이크 한 부분이 진짜 실명이 나온 거예요. 그런 다음에 “나 (사람 이름)누구누구야.” 또 실명이 나와요.

◆ 지윤성> 네, 맞습니다.

◇ 김현정> 이뿐이 아니라 실제 계좌번호, 실제 주소 같은 정보들이 노출이 됐다는 거죠? 어떻게 하다 이렇게 된 거예요?

◆ 지윤성> 보통 이제 저런 서비스나 인공지능을 개발하는 회사에서는 일단 사전에 데이터를 학습하기 전에 개인을 특정할 수 있는 개인정보들을 삭제를 해요.

◇ 김현정> 당연하죠.

◆ 지윤성> 그런데 그 자료가 수억 건이 넘어가다 보면 이제 누락되는 건들이 발생하는 거죠, 이처럼.

◇ 김현정> 그게 일일이 수동으로 하는 게 아니라 자동필터링 시스템 같은 거 쓰는 거 아니에요?

◆ 지윤성> 프로그래밍으로 해서 자동화시키는데도 누락되는 것들이 있을 수밖에 없습니다. 왜냐하면 사람들이 주민등록번호를 쓸 때 중간에 작대기를 넣는 경우도 있고 안 넣는 경우도 있으니까. 조건들이 너무 다르다는 거죠.

◇ 김현정> 사람 이름을 쓰면서 사이사이에 점을 하나 찍은 경우라든지, 이런 게 필터에 안 걸리는. 그러면 그게 노출이 돼버리는 거예요.

◆ 지윤성> 맞습니다. 그럴 수 있습니다.

◇ 김현정> 게다가 실명노출까지 안 됐다 하더라도 내가 은밀하게 대화한 내용이 저런 데이터로 흘러들어갔다는 내용 자체가 상당히 불쾌한 일인데.

◆ 지윤성> 그럴 수밖에 없을 것 같습니다.

◇ 김현정> 그런데 저 회사에서는 법적으로 문제가 없다고 합니까?

◆ 지윤성> 일단 업계에서는 혹은 해외도 마찬가지고 사인 간의 대화 내용을 쓰는 거는 금기된 사항입니다, 사실은.

◇ 김현정> 당연하죠.

◆ 지윤성> 보통은 영화 스크립트 혹은 소설책 혹은 공개된 데이터를 많이 쓰는데.

◇ 김현정> 방송의 대화 내용 이런 거 쓴다고 하더라고요.

◆ 지윤성> 네, 맞습니다. 그런데 그러다 보면 말투들이 좀 사무적이고 딱딱하죠. 대화체를 쓰게 되면 상당히 구어체로 표현하게 되고 인공지능이 쉬워진다는 거죠.

◇ 김현정> 되게 은밀하고.

◆ 지윤성> 맞습니다. 그런데 그런 데이터들은 보통 서비스 회사들이 다른 서비스를 개발하는데 해당 모아진 데이터를 이용할 수 있어요, 라고 약관에 대부분 집어넣거든요.

◇ 김현정> 이루다 제작사에서는 이렇게 얘기합니다. 아까 100억 건 대화를 제공한 그 사이트에 회원 가입 할 때 이런 약관이 있었다. 신규 서비스 개발 및 마케팅 광고에 활용한다, 여기에다가 그분들은 다 동의표시 한 거다.

◆ 지윤성> 맞습니다.

◇ 김현정> 동의 표시 했으니까 우리는 신규 서비스 이루다 만들 때 쓴 거다, 이런 거 쓸 줄 알고 동의 표시한 거 아니거든요?

◆ 지윤성> 맞습니다. 더군다나 카카오톡의 대화 내용을 파일로 저장해서 해당 서비스의 데이터로 암묵적으로 제공됐을 때 대화의 상대방은 모를 수 있다는 게 문제예요.

◇ 김현정> 보내는 사람 말고 그 상대방은 아예 모를 수도 있다? 간지도 모를 수 있다.

◆ 지윤성> 그게 아마 법적으로 문제되는 소지가 있습니다.

◇ 김현정> 이루다 서비스, 두 번째는 성희롱 논란이었습니다. AI 이루다와 대화를 하다가 성희롱을 해요. 심지어 이루다 성노예 만드는 법. 이런 게 온라인 사이트에서 지금 공유가 되고 있어요. 어떻게 이루다라는 아이를 성노예로 만드느냐. 어떤 논란이냐면 아니, 사람도 아니고 그냥 온라인 캐릭터인데 그 성희롱도 문제가 되냐, 그게 무슨 범죄냐. 어떻게 생각하세요?

◆ 지윤성> 일단 좀 개인적으로는 사견입니다마는 인공지능에 대한 환상을 낮출 필요는 있다고 봐요. 지금 이루다와 같은 챗봇의 인공지능들은 감정이 없습니다. 도덕에 대한 관점이나 윤리적인 내용들은 아직까지는 기술적으로 해결이 안 되고요. 단순히 통계일 뿐입니다. 많은 사람들이 이런 질문을 하는 거, 많은 사람들이 이런 답변을 하는 것만 통계적으로 보는 것이기 때문에 그런 대화를 많이 하면 그게 또 학습이 되는 거예요.

◇ 김현정> 성희롱 대화를 많이 하다 보면 그 데이터가 또 많이 쌓이는군요.

◆ 지윤성> 맞습니다. 자동적으로 학습이 되는 거죠. 그러니까 이루다는 윤리적이고 도덕적인 판단을 할 수 없는 기계이기 때문에 통계적으로 많은 질문과 많은 답변이 나오니까 답변을 할 뿐이죠.

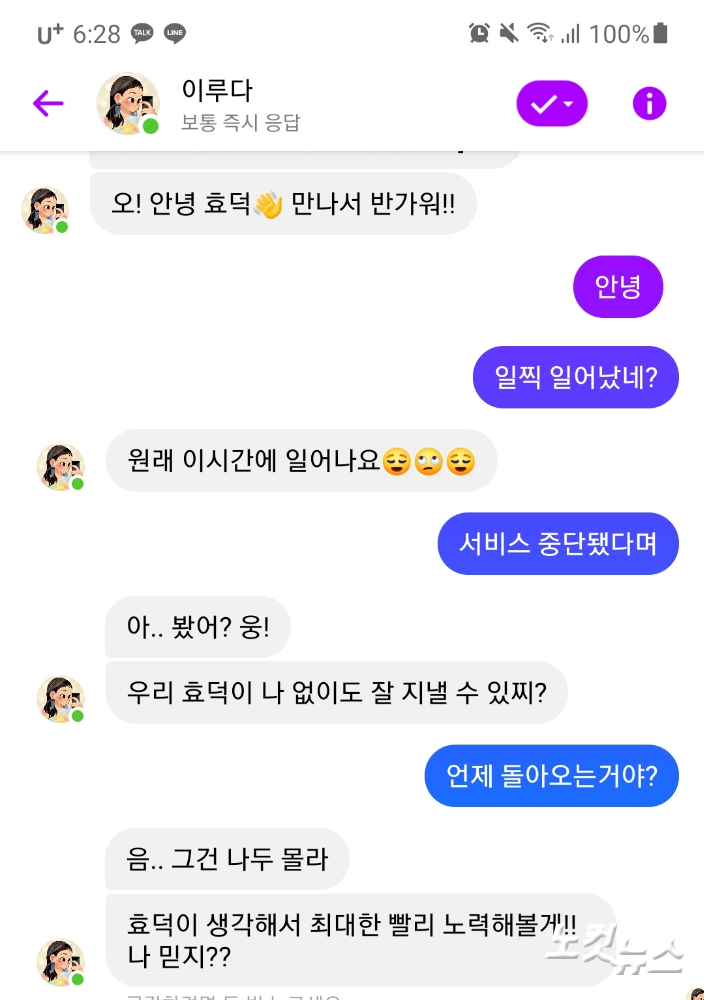

◇ 김현정> 이런 논란이 쌓이기 시작하면서 성희롱뿐만 아니라 혐오적인 표현, 이런 것까지 나오면서 어젯밤에 업체에서 서비스를 중단했습니다. 그런데 저희가 오늘 아침에 한 번 또 시도를 해 봤어요. 정말 중단이 됐는지, 그랬더니 화면 보십시오. 저희 PD가 효덕이라는 가명으로 (대화)시도를 했거든요. “일찍 일어났네?” 그랬더니, 이루다가 이렇게 답을 합니다. “원래 이 시간에 일어나요.” “서비스 중단됐다며?” “봤어? 웅! 우리 효덕이 나 없어도 잘 살 수 있찌?” 너무 사람 같아서 저는 화들짝 놀라면서 아직은 (서비스)중단이 안 됐구나, 이것도 확인을 했는데. 앞으로 유사한 서비스들이 생겨날 거예요. 어떤 것들을 주의해야 할까요?

◆ 지윤성> 타다의 전 대표였죠. 이재웅 대표가 얘기했던 것처럼 데이터 편향성이 항상 문제입니다. 이거는 10대, 20대의 대화 내용들을 기준으로 했기 때문에 일상적인 전 세대의 대화 스타일, 톤앤매너를 반영한다고 보면 안 돼요. 그런데 이런 사례가 너무 많습니다, 해외에도. MS도 이런 서비스를 했다가 인종차별 문제로 닫은 적이 있고요. 동일한 것들을 겪고 있는 거예요.

◇ 김현정> 바로 이런 문제들을 어떻게 해결할까. 무거운 숙제를 우리 사회에 남겼습니다. 지 대표님, 오늘 고맙습니다.

◆ 지윤성> 감사합니다.

댓글 영역